Страница:

Владимир Николаевич Яшин

Информатика: аппаратные средства персонального компьютера

Предисловие

Учебное пособие предназначено для подготовки специалистов экономического профиля в соответствии с Государственным стандартом в области общих математических и естественно-научных дисциплин по базовой дисциплине «Информатика» (ЕН.Ф.02), предусмотренной учебными планами высших учебных заведений, занимающихся подготовкой специалистов в области экономики.

Основная цель данного учебного пособия – возможность приобретения студентами теоретических и практических знаний в области основ информатики и аппаратных средств персонального компьютера, который является одним из базовых компонентов любой современной информационной системы. Одной из частных целей является преодоление негативной тенденции, связанной с поверхностным рассмотрением вопросов, касающихся аппаратных средств персональных компьютеров. Считается, что в области информационных технологий для специалиста экономического профиля наиболее важны знания в узкой области программного обеспечения, связанного с его непосредственной деятельностью, а вопросы аппаратного обеспечения должны решать за него технические специалисты. С одной стороны, это оправдано, поскольку реализуется принцип разделения труда, но, с другой – технический прогресс в области информатики и информационных технологий требует от специалистов экономического профиля отслеживать состояние и тенденции развития аппаратных средств, поскольку эффективное решение многих экономических задач опирается на аппаратные средства персонального компьютера. Кроме того, многим студентам, обучающимся на различных экономических специальностях, из-за отсутствия соответствующей базовой подготовки по информатике и зачастую в связи с нехваткой времени, бывает достаточно трудно разобраться в сложных вопросах технического устройства персонального компьютера, решение которых нужно искать в различных литературных источниках. В данном учебном пособии обобщены и систематизированы необходимые студентам сведения.

Первая глава посвящена рассмотрению таких понятий, как информация, информационный процесс и информационная система, с современных позиций информатики. Рассмотрены существующие подходы к определению количества информации и единицы ее измерения.

Вторая глава связана с рассмотрением вопросов, касающихся кодирования информации с помощью систем счисления. Рассмотрены системы счисления, применяемые при компьютерной обработке информации, арифметические операции над числами в различных системах счисления, и показано, как кодируются числа в компьютере.

Третья глава посвящена кодированию текстовой и графической информации, показаны способы ее кодирования и их отличия.

В четвертой главе рассмотрены логические основы компьютерной техники: логические переменные и логические операции; основные законы алгебры логики и правила преобразования логических выражений; логические функции и таблицы истинности; логические схемы и их синтез.

В пятой главе, посвященной структурной организации и аппаратным средствам персонального компьютера, рассмотрены вопросы классификации компьютеров, структуры персонального компьютера и его аппаратных средств, определения состава и характеристик оборудования персонального компьютера.

В шестой главе рассматривается компьютерная организация данных и их обработка. Даны основные определения и понятия информации и данных, приведены типы и структуры данных, показана организация данных на устройствах с прямым и последовательным доступом, рассмотрены файлы данных, файловые структуры и системы. Описаны технические средства, используемые в качестве накопителей информации. В конце каждой главы приведены примеры и упражнения для самостоятельного выполнения, которые могут быть использованы при проведении практических занятий.

Для решения задач в многочисленных примерах часто привлекаются различные компьютерные программные средства, приведено их описание и применение. Такой подход способствует формированию убеждения в необходимости оптимального выбора программных и аппаратных средств персонального компьютера при решении конкретных задач, а также позволяет приобрести навыки при работе с этими программными средствами.

Автор выражает глубокую признательность доценту А.А. Тихомирову, профессору В.В. Мотову, доценту В.А. Лукиных, Е.М. Бородавкиной за критические замечания и советы, высказанные в ходе подготовки данного учебного пособия, а также доценту Б.Н. Леонтьеву за поддержку и помощь при его написании.

Основная цель данного учебного пособия – возможность приобретения студентами теоретических и практических знаний в области основ информатики и аппаратных средств персонального компьютера, который является одним из базовых компонентов любой современной информационной системы. Одной из частных целей является преодоление негативной тенденции, связанной с поверхностным рассмотрением вопросов, касающихся аппаратных средств персональных компьютеров. Считается, что в области информационных технологий для специалиста экономического профиля наиболее важны знания в узкой области программного обеспечения, связанного с его непосредственной деятельностью, а вопросы аппаратного обеспечения должны решать за него технические специалисты. С одной стороны, это оправдано, поскольку реализуется принцип разделения труда, но, с другой – технический прогресс в области информатики и информационных технологий требует от специалистов экономического профиля отслеживать состояние и тенденции развития аппаратных средств, поскольку эффективное решение многих экономических задач опирается на аппаратные средства персонального компьютера. Кроме того, многим студентам, обучающимся на различных экономических специальностях, из-за отсутствия соответствующей базовой подготовки по информатике и зачастую в связи с нехваткой времени, бывает достаточно трудно разобраться в сложных вопросах технического устройства персонального компьютера, решение которых нужно искать в различных литературных источниках. В данном учебном пособии обобщены и систематизированы необходимые студентам сведения.

Первая глава посвящена рассмотрению таких понятий, как информация, информационный процесс и информационная система, с современных позиций информатики. Рассмотрены существующие подходы к определению количества информации и единицы ее измерения.

Вторая глава связана с рассмотрением вопросов, касающихся кодирования информации с помощью систем счисления. Рассмотрены системы счисления, применяемые при компьютерной обработке информации, арифметические операции над числами в различных системах счисления, и показано, как кодируются числа в компьютере.

Третья глава посвящена кодированию текстовой и графической информации, показаны способы ее кодирования и их отличия.

В четвертой главе рассмотрены логические основы компьютерной техники: логические переменные и логические операции; основные законы алгебры логики и правила преобразования логических выражений; логические функции и таблицы истинности; логические схемы и их синтез.

В пятой главе, посвященной структурной организации и аппаратным средствам персонального компьютера, рассмотрены вопросы классификации компьютеров, структуры персонального компьютера и его аппаратных средств, определения состава и характеристик оборудования персонального компьютера.

В шестой главе рассматривается компьютерная организация данных и их обработка. Даны основные определения и понятия информации и данных, приведены типы и структуры данных, показана организация данных на устройствах с прямым и последовательным доступом, рассмотрены файлы данных, файловые структуры и системы. Описаны технические средства, используемые в качестве накопителей информации. В конце каждой главы приведены примеры и упражнения для самостоятельного выполнения, которые могут быть использованы при проведении практических занятий.

Для решения задач в многочисленных примерах часто привлекаются различные компьютерные программные средства, приведено их описание и применение. Такой подход способствует формированию убеждения в необходимости оптимального выбора программных и аппаратных средств персонального компьютера при решении конкретных задач, а также позволяет приобрести навыки при работе с этими программными средствами.

Автор выражает глубокую признательность доценту А.А. Тихомирову, профессору В.В. Мотову, доценту В.А. Лукиных, Е.М. Бородавкиной за критические замечания и советы, высказанные в ходе подготовки данного учебного пособия, а также доценту Б.Н. Леонтьеву за поддержку и помощь при его написании.

Глава 1

Информация, информационные процессы и системы

1.1. Понятия информации, информационного процесса и информационной системы

Понятия «информация», «информационный процесс» и «информационная система» являются основополагающими в курсе информатики, поэтому их формирование было и остается сложной проблемой, связанной в первую очередь с различными мировоззренческими подходами как отдельных авторов, так и представителей различных научных направлений и школ. Информация как научная категория – предмет изучения многих научных дисциплин: философии, информатики, физики, биологии и т. д. Информация, материя, энергия являются базовыми научными категориями, для которых не существует строгих научных определений, поэтому их заменяют соответствующими понятиями, и попытки выразить одно базовое понятие через другое нельзя считать успешными. Слово «информация» происходит от латинского слова informatio, что в переводе означает «сведение, ознакомление, разъяснение». Дословная трактовка означает то, что присуще человеческому сознанию и общению и не отражает многообразия свойств информации, которое проявляется не только на уровне общения между людьми, но и на уровне живой и неживой природы, включая и технические устройства, созданные человеком.

Существует достаточно много различных определений понятия «информация», но ни одно из них не может быть принято в качестве основного, поскольку все они отражают только отдельные свойства информации, к которым можно отнести:

• дуализм – свойство информации, которое характеризует ее двойственность. С одной стороны, она объективна, так как не зависит от воспринимаемого ее объекта, а с другой – субъективна, поскольку может трактоваться субъектами по-разному;

• достоверность – свойство информации, которое характеризует степень соответствия информации реальному объекту с заданной точностью;

• адекватность – свойство информации, которое устанавливает соответствие создаваемого с помощью информации образа реальному объекту, процессу или явлению и т. д.

Этот ряд свойств информации может быть продолжен. Однако здесь наиболее важно отметить следующее: совокупность свойств информации, характеризующих степень ее соответствия потребностям пользователей, называется качеством информации [1].

При определении понятия информации целесообразно использовать подход, нашедший применение в теории информации и основанный на введении соответствующих ограничений на совокупность свойств информации, проявляющихся при взаимодействии объектов, организованных в систему.

Введем общее ограничение, при котором будем рассматривать свойства информации, проявляющиеся только на уровне человеческого сознания.

Если не принимать во внимание такие свойства информации, как смысловое содержание, полезность, актуальность и т. д., то при определении понятия информации можно ограничиться только вероятностным (энтропийным) уровнем рассмотрения этого понятия. (Этот уровень рассмотрения называют также синтаксическим.) На данном уровне устанавливаются внешние характеристики информации независимо от ее смыслового содержания и характера использования. При таком рассмотрении под информацией следует понимать меру устранения неопределенности в отношении интересующего нас исхода или, что то же самое, информация есть снятая неопределенность при осуществлении выбора из множества альтернатив.

Если принять во внимание только свойство информации, связанное с ее смысловым содержанием, то при определении понятия информации можно ограничиться смысловым или семантическим уровнем рассмотрения этого понятия. В этом случае под информацией следует понимать меру, связывающую ее смысловое содержание со способностью человека ее осмыслить.

Если принять во внимание только свойство информации, связанное с ее полезностью, то при определении понятия информации можно ограничиться прагматическим уровнем рассмотрения. В этом случае под информацией можно понимать меру достижения потребителем информации (человеком) поставленной практической цели.

Таким образом, принципиально может существовать бесконечно много уровней ограничений и соответственно понятий информации. Данный вывод не содержит противоречий, поскольку учитывает одно из основных свойств информации быть всеобъемлющей. Если постулировать данное свойство, т. е. принять его как всеобщее свойство материи, связанное с отражением (материалистический подход), то можно говорить о существовании информационного поля, для которого необходимо наличие соответствующих условий.

К таким условиям можно отнести наличие:

а) источника информационного поля;

б) среды распространения информационного поля (канала передачи);

в) материальных посредников распространения информационного поля;

г) приемника информационного поля.

В качестве источника информационного поля могут выступать естественные природные источники, т. е. явления живой и неживой природы, и искусственные источники, созданные человеком. Наличие источника информационного поля – необходимое условие для возникновения и существования информационного поля.

Среда распространения разделяется на среду с распределенными параметрами (естественные природные среды – воздушные, водные и др.) и среду с сосредоточенными параметрами (искусственные каналы передачи), созданные человеком. Наличие среды распространения информационного поля – также необходимое условие для возникновения и существования информационного поля.

В качестве материальных посредников распространения информационного поля можно выделить естественных (природных) и искусственных посредников, к которым можно отнести знаки, сигналы и сообщения. Существует достаточно много определений этих понятий, однако остановимся на их трактовке исходя из представлений, выработанных семиологией – наукой, изучающей знаковые системы.

Знак, или символ, можно рассматривать как некий чувственно воспринимаемый объект, который условно представляет и отсылает к обозначаемому им предмету, явлению, событию или действию. Если придерживаться этого определения, то между знаком (символом) и обозначаемым им предметом (референтом) устанавливается условная связь в виде понятия (референции) об этом предмете, которую можно представить с помощью известного треугольника Огдена и Ричардса (рис. 1.1).

Рис. 1.1. Треугольник Огдена и Ричардса

Рис. 1.1. Треугольник Огдена и Ричардса

Связь между знаком и предметом условна (на рис. 1.1 она показана пунктирной линией), поскольку прямой связи между ними нет. В действительности существуют знаки (символы), у которых есть понятия, но нет предмета, например некоторые знаки Зодиака (Водолей, Стрелец), мифологические персонажи (Единорог) и т. д.

Сигнал можно рассматривать как материальный носитель, с помощью которого передаются характеристики информационного поля. В общем случае под сигналом следует понимать физический процесс, представленный в той или иной материально-энергетической форме (электрической, световой, звуковой и т. д.) и распространяющийся в определенной среде. Сигналу как процессу свойственны непрерывность и дискретность во времени, т. е. сигналы могут быть непрерывными или дискретными. Для передачи характеристик информационного поля сигнал как материальный носитель подвергается модуляции, т. е. определенному воздействию со стороны этихарактеристик. Кроме того, на сигнал может воздействовать и сама среда распространения сигнала в виде неблагоприятного воздействия – помехи. Свойства сигналов изучается в отдельном разделе кибернетики – теории сигналов и цепей.

Сообщение можно отнести к основной характеристике информационного поля. Оно является формой представления информационного поля в виде совокупности знаков, которое передается с помощью сигналов от источника к приемнику. Сообщение как форма представления информационного поля подвергается соответствующему кодированию с помощью различных знаковых систем. Примерами сообщений могут быть телеграммы, речь, музыка, телевизионное изображение, данные на выходе вычислительных и измерительных систем и т. д.

В качестве приемника информационного поля могут выступать естественные природные приемники, т. е. объекты живой и неживой природы, и искусственные приемники, созданные человеком и соответствующим образом настроенные на прием. В качестве приемника информационного поля может выступать непосредственно и сам человек. Наличие приемника информационного поля не является необходимым условием для возникновения и существования информационного поля, поскольку оно существует объективно, т. е. независимо от нас, и необязательно подлежит осмыслению.

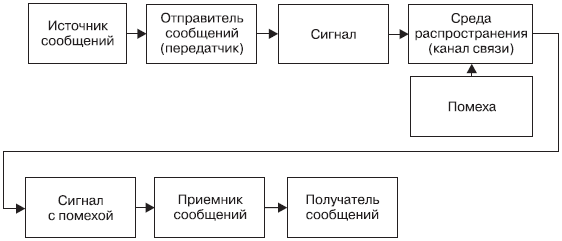

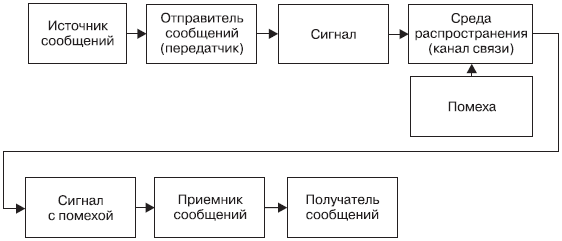

Таким образом, в общем случае коммуникативный процесс между источником и приемником сообщений можно представить в виде структурной схемы (рис. 1.2).

Рис. 1.2. Коммуникативный процесс между источником и получателем сообщений

Рис. 1.2. Коммуникативный процесс между источником и получателем сообщений

В подтверждение тому, что существует много различных понятий информации, приведем еще одно, сформулированное на основе условий существования информационного поля: информация есть свойство информационного поля, которое проявляется при обязательном выполнении всех условий его возникновения и существования.

Говоря об информационном поле, необходимо также заметить, что ему присущи многообразие видов и форм представления, наличие энергетических, геометрических (пространственных), временных и другихарактеристик, а также изменение этихарактеристик под воздействием неблагоприятных факторов (помех).

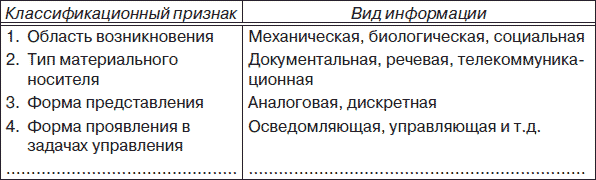

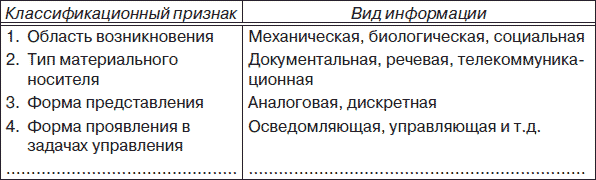

Многообразие видов информационного поля приводит и к многообразию видов самой информации. Для выявления определенных видов информации необходимо согласно существующим методам классификации применить тот или иной классификационный признак (критерий) для их разграничения. Таких классификационных признаков может быть достаточно много. В табл. 1.1 приведены некоторые из них и соответствующие им виды информации.

Приведенные в табл. 1.1 виды информации могут образовывать иерархические структуры, для которыхарактерно расположение видов информации в порядке от высокого уровня к низкому. Например, по области возникновения (классификационный признак первого уровня) различают: механическую (отражающую процессы и явления неживой природы), биологическую (отражающую процессы и явления живой природы) и социальную (отражающую процессы и явления в человеческом обществе). Социальную информацию в свою очередь по назначению (классификационный признак второго уровня) можно разделить натри вида: массовую, специальную и личную. Если использовать классификационный признак третьего уровня (специфика проявления), то массовый и специальный вид информации можно разделить на подвиды. Так, массовую информацию можно представить в виде общественно-политической и научно-популярной, а специальную – в виде научной, технической, экономической и управляющей [2].

Приведенные в табл. 1.1 виды информации могут образовывать иерархические структуры, для которыхарактерно расположение видов информации в порядке от высокого уровня к низкому. Например, по области возникновения (классификационный признак первого уровня) различают: механическую (отражающую процессы и явления неживой природы), биологическую (отражающую процессы и явления живой природы) и социальную (отражающую процессы и явления в человеческом обществе). Социальную информацию в свою очередь по назначению (классификационный признак второго уровня) можно разделить натри вида: массовую, специальную и личную. Если использовать классификационный признак третьего уровня (специфика проявления), то массовый и специальный вид информации можно разделить на подвиды. Так, массовую информацию можно представить в виде общественно-политической и научно-популярной, а специальную – в виде научной, технической, экономической и управляющей [2].

Таким образом, может существовать достаточно много классификационных признаков и соответствующих им видов информации.

Поскольку данное учебное пособие ориентировано в основном на студентов экономических специальностей, приведем здесь одно из определений понятия экономической информации. Экономическая информация – это информация, которая используется при осуществлении функций управления экономическими процессами, т. е. отражает и обслуживает процессы производства, распределения, обмена и потребления материальных благ. Экономическая информация служит основой для осуществления управления процессами в области экономики и обладает рядом характерных свойств: многоцелевым назначением, цикличностью, простотой математических операций, сложностью логических процедур и т. д. [2].

С понятием «информация» тесно связаны такие понятия, как «информационный процесс» и «информационная система». Это также достаточно сложные нормы, трактовка которых далеко не однозначна.

Под информационным процессом в данном случае будем понимать последовательность действий, выполняемых с информацией. К таким действиям можно отнести отбор (восприятие), преобразование, передачу, обработку, хранение и поиск информации.

Кратко охарактеризуем каждое из этих действий (более подробное их описание можно найти в соответствующей литературе [1,3]).

Отбор информации связан с целенаправленным извлечением и анализом информации об объекте, процессе или явлении. Результатом этого отбора являются формирование модели (образа) объекта, процесса или явления, их опознание и оценка. Отбор информации выполняет несколько функций, среди которых можно выделить две важных функции: оценка информации на значимость и сжатие информации [3]. При оценке информации на значимость происходит ее селекция, или информационная фильтрация, результатом которой является отделение полезной информации от информационных шумов (помех). Сжатие информации необходимо для ее представления в компактном виде, позволяющем более эффективно использовать каналы, по которым передается информация, и средства ее хранения.

Преобразование информации включает в себя операции, связанные с нормализацией (приведение к определенным нормам), аналого-цифровым преобразованием, кодированием и т. д. Результатом преобразования информации является материальный носитель (сигнал), представленный в форме, удобной для передачи, обработки и хранения.

Передача информации – важная составляющая информационного процесса, в результате которого происходит транспортировка информации от источника информации к приемнику. Передача осуществляется в среде распространения по соответствующим каналам, имеющим различную физическую природу: электромагнитную, электрическую, оптическую и т. д.

Обработка информации также является важной составляющей информационного процесса. Под обработкой информации можно понимать действия, производимые с информацией по определенным законам (математики, логики, физики и т. д.) и неформальным правилам (опыт, интуиция, здравый смысл и т. д.). Результатом обработки является тоже информация, которая может быть представлена в иных формах (например, упорядоченная по каким-то признакам) или содержать ответы на поставленные вопросы [1]. В случае если процесс обработки подлежит формализации, он может осуществляться техническими средствами, например обработка информации на компьютере.

Хранение информации связано с ее записью на некоторый материальный носитель с целью дальнейшего поиска, извлечения и использования. В качестве таких носителей могут использоваться бумага, магнитная лента, накопители на гибких и жестких магнитных дисках, на оптических и магнитооптических дисках и т. д.

В заключение, говоря об информационном процессе, необходимо отметить, что это не простая последовательность действий, выполняемых с информацией, а их сложная взаимосвязь, взаимопроникновение и развитие. В каждом действии (составляющем процесс информации) можно найти признаки других составляющих: в отборе – преобразование, в хранении – передачу, в передаче – обработку и т. д.

Реализуются информационные процессы в системах, которые называются информационными, при этом под системой в общем случае понимается совокупность объектов и отношений между ними, существующая как единое целое.

Информационные системы также можно классифицировать по различным признакам: по сфере применения, организации информационных процессов, территориальному признаку, степени автоматизации информационных процессов и т. д. Например, по сфере применения информационные системы можно подразделить на административные, экономические, производственные, медицинские и т. д.

Для экономической информационной системы характерными признаками являются: непрерывное развитие, обусловленное появлением новых потребностей, сменой механизма хозяйствования; многоцелевой характер функционирования; присутствие человека как основного элемента системы. Под экономической информационной системой (ЭИС) будем понимать совокупность внутренних и внешних потоков прямой и обратной информационной связи экономического объекта, методов, средств, специалистов, участвующих в процессе обработки информации и выработке управленческих решений [2]. В качестве примера можно привести финансовые, банковские, страховые и тому пободные ЭИС.

Существует достаточно много различных определений понятия «информация», но ни одно из них не может быть принято в качестве основного, поскольку все они отражают только отдельные свойства информации, к которым можно отнести:

• дуализм – свойство информации, которое характеризует ее двойственность. С одной стороны, она объективна, так как не зависит от воспринимаемого ее объекта, а с другой – субъективна, поскольку может трактоваться субъектами по-разному;

• достоверность – свойство информации, которое характеризует степень соответствия информации реальному объекту с заданной точностью;

• адекватность – свойство информации, которое устанавливает соответствие создаваемого с помощью информации образа реальному объекту, процессу или явлению и т. д.

Этот ряд свойств информации может быть продолжен. Однако здесь наиболее важно отметить следующее: совокупность свойств информации, характеризующих степень ее соответствия потребностям пользователей, называется качеством информации [1].

При определении понятия информации целесообразно использовать подход, нашедший применение в теории информации и основанный на введении соответствующих ограничений на совокупность свойств информации, проявляющихся при взаимодействии объектов, организованных в систему.

Введем общее ограничение, при котором будем рассматривать свойства информации, проявляющиеся только на уровне человеческого сознания.

Если не принимать во внимание такие свойства информации, как смысловое содержание, полезность, актуальность и т. д., то при определении понятия информации можно ограничиться только вероятностным (энтропийным) уровнем рассмотрения этого понятия. (Этот уровень рассмотрения называют также синтаксическим.) На данном уровне устанавливаются внешние характеристики информации независимо от ее смыслового содержания и характера использования. При таком рассмотрении под информацией следует понимать меру устранения неопределенности в отношении интересующего нас исхода или, что то же самое, информация есть снятая неопределенность при осуществлении выбора из множества альтернатив.

Если принять во внимание только свойство информации, связанное с ее смысловым содержанием, то при определении понятия информации можно ограничиться смысловым или семантическим уровнем рассмотрения этого понятия. В этом случае под информацией следует понимать меру, связывающую ее смысловое содержание со способностью человека ее осмыслить.

Если принять во внимание только свойство информации, связанное с ее полезностью, то при определении понятия информации можно ограничиться прагматическим уровнем рассмотрения. В этом случае под информацией можно понимать меру достижения потребителем информации (человеком) поставленной практической цели.

Таким образом, принципиально может существовать бесконечно много уровней ограничений и соответственно понятий информации. Данный вывод не содержит противоречий, поскольку учитывает одно из основных свойств информации быть всеобъемлющей. Если постулировать данное свойство, т. е. принять его как всеобщее свойство материи, связанное с отражением (материалистический подход), то можно говорить о существовании информационного поля, для которого необходимо наличие соответствующих условий.

К таким условиям можно отнести наличие:

а) источника информационного поля;

б) среды распространения информационного поля (канала передачи);

в) материальных посредников распространения информационного поля;

г) приемника информационного поля.

В качестве источника информационного поля могут выступать естественные природные источники, т. е. явления живой и неживой природы, и искусственные источники, созданные человеком. Наличие источника информационного поля – необходимое условие для возникновения и существования информационного поля.

Среда распространения разделяется на среду с распределенными параметрами (естественные природные среды – воздушные, водные и др.) и среду с сосредоточенными параметрами (искусственные каналы передачи), созданные человеком. Наличие среды распространения информационного поля – также необходимое условие для возникновения и существования информационного поля.

В качестве материальных посредников распространения информационного поля можно выделить естественных (природных) и искусственных посредников, к которым можно отнести знаки, сигналы и сообщения. Существует достаточно много определений этих понятий, однако остановимся на их трактовке исходя из представлений, выработанных семиологией – наукой, изучающей знаковые системы.

Знак, или символ, можно рассматривать как некий чувственно воспринимаемый объект, который условно представляет и отсылает к обозначаемому им предмету, явлению, событию или действию. Если придерживаться этого определения, то между знаком (символом) и обозначаемым им предметом (референтом) устанавливается условная связь в виде понятия (референции) об этом предмете, которую можно представить с помощью известного треугольника Огдена и Ричардса (рис. 1.1).

Связь между знаком и предметом условна (на рис. 1.1 она показана пунктирной линией), поскольку прямой связи между ними нет. В действительности существуют знаки (символы), у которых есть понятия, но нет предмета, например некоторые знаки Зодиака (Водолей, Стрелец), мифологические персонажи (Единорог) и т. д.

Сигнал можно рассматривать как материальный носитель, с помощью которого передаются характеристики информационного поля. В общем случае под сигналом следует понимать физический процесс, представленный в той или иной материально-энергетической форме (электрической, световой, звуковой и т. д.) и распространяющийся в определенной среде. Сигналу как процессу свойственны непрерывность и дискретность во времени, т. е. сигналы могут быть непрерывными или дискретными. Для передачи характеристик информационного поля сигнал как материальный носитель подвергается модуляции, т. е. определенному воздействию со стороны этихарактеристик. Кроме того, на сигнал может воздействовать и сама среда распространения сигнала в виде неблагоприятного воздействия – помехи. Свойства сигналов изучается в отдельном разделе кибернетики – теории сигналов и цепей.

Сообщение можно отнести к основной характеристике информационного поля. Оно является формой представления информационного поля в виде совокупности знаков, которое передается с помощью сигналов от источника к приемнику. Сообщение как форма представления информационного поля подвергается соответствующему кодированию с помощью различных знаковых систем. Примерами сообщений могут быть телеграммы, речь, музыка, телевизионное изображение, данные на выходе вычислительных и измерительных систем и т. д.

В качестве приемника информационного поля могут выступать естественные природные приемники, т. е. объекты живой и неживой природы, и искусственные приемники, созданные человеком и соответствующим образом настроенные на прием. В качестве приемника информационного поля может выступать непосредственно и сам человек. Наличие приемника информационного поля не является необходимым условием для возникновения и существования информационного поля, поскольку оно существует объективно, т. е. независимо от нас, и необязательно подлежит осмыслению.

Таким образом, в общем случае коммуникативный процесс между источником и приемником сообщений можно представить в виде структурной схемы (рис. 1.2).

В подтверждение тому, что существует много различных понятий информации, приведем еще одно, сформулированное на основе условий существования информационного поля: информация есть свойство информационного поля, которое проявляется при обязательном выполнении всех условий его возникновения и существования.

Говоря об информационном поле, необходимо также заметить, что ему присущи многообразие видов и форм представления, наличие энергетических, геометрических (пространственных), временных и другихарактеристик, а также изменение этихарактеристик под воздействием неблагоприятных факторов (помех).

Многообразие видов информационного поля приводит и к многообразию видов самой информации. Для выявления определенных видов информации необходимо согласно существующим методам классификации применить тот или иной классификационный признак (критерий) для их разграничения. Таких классификационных признаков может быть достаточно много. В табл. 1.1 приведены некоторые из них и соответствующие им виды информации.

Таблица 1.1

Таким образом, может существовать достаточно много классификационных признаков и соответствующих им видов информации.

Поскольку данное учебное пособие ориентировано в основном на студентов экономических специальностей, приведем здесь одно из определений понятия экономической информации. Экономическая информация – это информация, которая используется при осуществлении функций управления экономическими процессами, т. е. отражает и обслуживает процессы производства, распределения, обмена и потребления материальных благ. Экономическая информация служит основой для осуществления управления процессами в области экономики и обладает рядом характерных свойств: многоцелевым назначением, цикличностью, простотой математических операций, сложностью логических процедур и т. д. [2].

С понятием «информация» тесно связаны такие понятия, как «информационный процесс» и «информационная система». Это также достаточно сложные нормы, трактовка которых далеко не однозначна.

Под информационным процессом в данном случае будем понимать последовательность действий, выполняемых с информацией. К таким действиям можно отнести отбор (восприятие), преобразование, передачу, обработку, хранение и поиск информации.

Кратко охарактеризуем каждое из этих действий (более подробное их описание можно найти в соответствующей литературе [1,3]).

Отбор информации связан с целенаправленным извлечением и анализом информации об объекте, процессе или явлении. Результатом этого отбора являются формирование модели (образа) объекта, процесса или явления, их опознание и оценка. Отбор информации выполняет несколько функций, среди которых можно выделить две важных функции: оценка информации на значимость и сжатие информации [3]. При оценке информации на значимость происходит ее селекция, или информационная фильтрация, результатом которой является отделение полезной информации от информационных шумов (помех). Сжатие информации необходимо для ее представления в компактном виде, позволяющем более эффективно использовать каналы, по которым передается информация, и средства ее хранения.

Преобразование информации включает в себя операции, связанные с нормализацией (приведение к определенным нормам), аналого-цифровым преобразованием, кодированием и т. д. Результатом преобразования информации является материальный носитель (сигнал), представленный в форме, удобной для передачи, обработки и хранения.

Передача информации – важная составляющая информационного процесса, в результате которого происходит транспортировка информации от источника информации к приемнику. Передача осуществляется в среде распространения по соответствующим каналам, имеющим различную физическую природу: электромагнитную, электрическую, оптическую и т. д.

Обработка информации также является важной составляющей информационного процесса. Под обработкой информации можно понимать действия, производимые с информацией по определенным законам (математики, логики, физики и т. д.) и неформальным правилам (опыт, интуиция, здравый смысл и т. д.). Результатом обработки является тоже информация, которая может быть представлена в иных формах (например, упорядоченная по каким-то признакам) или содержать ответы на поставленные вопросы [1]. В случае если процесс обработки подлежит формализации, он может осуществляться техническими средствами, например обработка информации на компьютере.

Хранение информации связано с ее записью на некоторый материальный носитель с целью дальнейшего поиска, извлечения и использования. В качестве таких носителей могут использоваться бумага, магнитная лента, накопители на гибких и жестких магнитных дисках, на оптических и магнитооптических дисках и т. д.

В заключение, говоря об информационном процессе, необходимо отметить, что это не простая последовательность действий, выполняемых с информацией, а их сложная взаимосвязь, взаимопроникновение и развитие. В каждом действии (составляющем процесс информации) можно найти признаки других составляющих: в отборе – преобразование, в хранении – передачу, в передаче – обработку и т. д.

Реализуются информационные процессы в системах, которые называются информационными, при этом под системой в общем случае понимается совокупность объектов и отношений между ними, существующая как единое целое.

Информационные системы также можно классифицировать по различным признакам: по сфере применения, организации информационных процессов, территориальному признаку, степени автоматизации информационных процессов и т. д. Например, по сфере применения информационные системы можно подразделить на административные, экономические, производственные, медицинские и т. д.

Для экономической информационной системы характерными признаками являются: непрерывное развитие, обусловленное появлением новых потребностей, сменой механизма хозяйствования; многоцелевой характер функционирования; присутствие человека как основного элемента системы. Под экономической информационной системой (ЭИС) будем понимать совокупность внутренних и внешних потоков прямой и обратной информационной связи экономического объекта, методов, средств, специалистов, участвующих в процессе обработки информации и выработке управленческих решений [2]. В качестве примера можно привести финансовые, банковские, страховые и тому пободные ЭИС.

1.2. Определение количества информации. Единицы измерения количества информации

Как уже отмечалось, понятие информации можно рассматривать при различных ограничениях, накладываемых на ее свойства, т. е. при различных уровнях рассмотрения. В основном выделяют три уровня – синтаксический, семантический и прагматический. Соответственно на каждом из них для определения количества информации применяют различные оценки.

На синтаксическом уровне для оценки количества информации используют вероятностные методы, которые принимают во внимание только вероятностные свойства информации и не учитывают другие (смысловое содержание, полезность, актуальность и т. д.). Разработанные в середине XX в. математические и, в частности, вероятностные методы позволили сформировать подход к оценке количества информации как к мере уменьшения неопределенности знаний. Такой подход, называемый также вероятностным, постулирует принцип: если некоторое сообщение приводит к уменьшению неопределенности наших знаний, то можно утверждать, что такое сообщение содержит информацию. При этом сообщения содержат информацию о каких-либо событиях, которые могут реализоваться с различными вероятностями. Формулу для определения количества информации для событий с различными вероятностями и получаемых от дискретного источника информации предложил американский ученый К. Шеннон в 1948 г. Согласно этой формуле количество информации может быть определено следующим образом:

где I – количество информации; N – количество возможных событий (сообщений); pi – вероятность отдельных событий (сообщений); Σ – математический знак суммы чисел.

где I – количество информации; N – количество возможных событий (сообщений); pi – вероятность отдельных событий (сообщений); Σ – математический знак суммы чисел.

Определяемое с помощью формулы (1.1) количество информации принимает только положительное значение. Поскольку вероятность отдельных событий меньше единицы, то соответственно выражение log^,– является отрицательной величиной и для получения положительного значения количества информации в формуле (1.1) перед знаком суммы стоит знак минус.

Если вероятность появления отдельных событий одинаковая и они образуют полную группу событий, т. е.

то формула (1.1) преобразуется в формулу Р. Хартли:

то формула (1.1) преобразуется в формулу Р. Хартли:

В формулах (1.1) и (1.2) отношение между количеством информации и соответственно вероятностью, или количеством, отдельных событий выражается с помощью логарифма. Применение логарифмов в формулах (1.1) и (1.2) можно объяснить следующим образом. Для простоты рассуждений воспользуемся соотношением (1.2). Будем последовательно присваивать аргументу N значения, выбираемые, например, из ряда чисел: 1, 2, 4, 8, 16, 32, 64 и т. д. Чтобы определить, какое событие из N равновероятных событий произошло, для каждого числа ряда необходимо последовательно производить операции выбора из двух возможных событий. Так, при N = 1 количество операций будет равно 0 (вероятность события равна 1), при N = 2, количество операций будет равно 1, при N = 4 количество операций будет равно 2, при N = 8, количество операций будет равно 3 и т. д. Таким образом получим следующий ряд чисел: 0, 1, 2, 3, 4, 5, 6 и т. д., который можно считать соответствующим значениям функции I в соотношении (1.2). Последовательность значений чисел, которые принимает аргумент N, представляет собой ряд, известный в математике как ряд чисел, образующих геометрическую прогрессию, а последовательность значений чисел, которые принимает функция I, будет являться рядом, образующим арифметическую прогрессию. Таким образом, логарифм в формулах (1.1) и (1.2) устанавливает соотношение между рядами, представляющими геометрическую и арифметическую прогрессии, что достаточно хорошо известно в математике.

В формулах (1.1) и (1.2) отношение между количеством информации и соответственно вероятностью, или количеством, отдельных событий выражается с помощью логарифма. Применение логарифмов в формулах (1.1) и (1.2) можно объяснить следующим образом. Для простоты рассуждений воспользуемся соотношением (1.2). Будем последовательно присваивать аргументу N значения, выбираемые, например, из ряда чисел: 1, 2, 4, 8, 16, 32, 64 и т. д. Чтобы определить, какое событие из N равновероятных событий произошло, для каждого числа ряда необходимо последовательно производить операции выбора из двух возможных событий. Так, при N = 1 количество операций будет равно 0 (вероятность события равна 1), при N = 2, количество операций будет равно 1, при N = 4 количество операций будет равно 2, при N = 8, количество операций будет равно 3 и т. д. Таким образом получим следующий ряд чисел: 0, 1, 2, 3, 4, 5, 6 и т. д., который можно считать соответствующим значениям функции I в соотношении (1.2). Последовательность значений чисел, которые принимает аргумент N, представляет собой ряд, известный в математике как ряд чисел, образующих геометрическую прогрессию, а последовательность значений чисел, которые принимает функция I, будет являться рядом, образующим арифметическую прогрессию. Таким образом, логарифм в формулах (1.1) и (1.2) устанавливает соотношение между рядами, представляющими геометрическую и арифметическую прогрессии, что достаточно хорошо известно в математике.

Для количественного определения (оценки) любой физической величины необходимо определить единицу измерения, которая в теории измерений носит название меры. Как уже отмечалось, информацию перед обработкой, передачей и хранением необходимо подвергнуть кодированию. Кодирование производится с помощью специальных алфавитов (знаковых систем). В информатике, изучающей процессы получения, обработки, передачи и хранения информации с помощью вычислительных (компьютерных) систем, в основном используется двоичное кодирование, при котором используется знаковая система, состоящая из двух символов 0 и 1. По этой причине в формулах (1.1) и (1.2) в качестве основания логарифма используется цифра 2.

На синтаксическом уровне для оценки количества информации используют вероятностные методы, которые принимают во внимание только вероятностные свойства информации и не учитывают другие (смысловое содержание, полезность, актуальность и т. д.). Разработанные в середине XX в. математические и, в частности, вероятностные методы позволили сформировать подход к оценке количества информации как к мере уменьшения неопределенности знаний. Такой подход, называемый также вероятностным, постулирует принцип: если некоторое сообщение приводит к уменьшению неопределенности наших знаний, то можно утверждать, что такое сообщение содержит информацию. При этом сообщения содержат информацию о каких-либо событиях, которые могут реализоваться с различными вероятностями. Формулу для определения количества информации для событий с различными вероятностями и получаемых от дискретного источника информации предложил американский ученый К. Шеннон в 1948 г. Согласно этой формуле количество информации может быть определено следующим образом:

Определяемое с помощью формулы (1.1) количество информации принимает только положительное значение. Поскольку вероятность отдельных событий меньше единицы, то соответственно выражение log^,– является отрицательной величиной и для получения положительного значения количества информации в формуле (1.1) перед знаком суммы стоит знак минус.

Если вероятность появления отдельных событий одинаковая и они образуют полную группу событий, т. е.

Для количественного определения (оценки) любой физической величины необходимо определить единицу измерения, которая в теории измерений носит название меры. Как уже отмечалось, информацию перед обработкой, передачей и хранением необходимо подвергнуть кодированию. Кодирование производится с помощью специальных алфавитов (знаковых систем). В информатике, изучающей процессы получения, обработки, передачи и хранения информации с помощью вычислительных (компьютерных) систем, в основном используется двоичное кодирование, при котором используется знаковая система, состоящая из двух символов 0 и 1. По этой причине в формулах (1.1) и (1.2) в качестве основания логарифма используется цифра 2.