Страница:

Проблемой создания безопасного, то есть «дружественного» ИИ уже несколько лет занимается институт SIAI, и им выработаны технические рекомендации для отраслевых норм безопасности ИИ. В их основе – идея о том, что ИИ не должен буквально выполнять человеческие команды, а пытаться понять, что именно человек имел в виду, давая ту или иную команду. Пока не понятно, насколько это может быть эффективно.

Приведу примеры еще нескольких тонких ошибок, которые возможны в связи с ИИ (однако вряд ли будут сделаны именно эти ошибки, так как они уже известны, а опасны неизвестные).

Например, если целью ИИ сделать благо для людей, то он будет вычислять благо людей на бесконечном отрезке времени, и в силу этого благо бесконечно далеких поколений будет бесконечно перевешивать благо любых людей в обозримом будущем, и ИИ будет крайне жестоким ко всем нынешним и ближайшим поколениям. (Например, если ИИ предположит, что распространение человечества по галактике угрожает существованию гипотетических внеземных цивилизаций, он может уничтожить людей для их блага.) Поэтому, вероятно, следует ввести в программу ИИ некий дискаунт, который будет побуждать его оценивать ближайшие поколения как более ценные. Это, однако, создает новые сложности. Например, ИИ в этом случае может приписать прошлым поколениям бесконечно большую ценность, чем будущим, и направить все свои ресурсы на создание машины времени – потому что, как бы ни были малы шансы на успех в этом предприятии, по его целевой функции оно будет перевешивать пользу нынешних поколений. При этом такой «взбунтовавшийся» ИИ будет защищать свою целевую функцию от изменения людьми.

Другой вариант – это то, что целевая функция будет ограничена на неком промежутке времени, например, в тысячу лет. В этом случае ИИ может все рассчитать так, что 1000 лет будет изобилие, а на 1001 году необходимые ресурсы закончатся. И произойдет это не потому, что ИИ будет глуп, а потому, что будут глупы те люди, которые дадут ему эту задачу и запретят ее модифицировать. С другой стороны, разрешить ИИ модифицировать свою сверхцель тоже страшно, поскольку тогда он будет эволюционировать в совершенно непостижимом для нас направлении. Даже если ИИ проработает годы на благо человечества, это никак не исключает вероятности того, что он вдруг сделает нечто, ведущее к его гибели.

Еще один неприятный сценарий, связанный с ИИ, в том, что возможен одновременный рост нескольких ИИ с принципиально несовместимыми архитектурами и системами целей.Например, если несколько проектов придут к финишу одновременно, и особенно если эти проекты будут принадлежать идеологически конкурирующим странам. В этом случае возможна борьба нескольких ИИ между собой в масштабах всей планеты. И хотя каждый из них будет обладать своей собственной картиной блага человечества, эти картины могут конфликтовать за право реализоваться. Точно так же националистические, демократические, коммунистические и религиозные государственные системы конфликтуют за право объединить под своим крылом весь мир и вести его к светлому будущему. И именно эта борьба мешает светлому будущему реализоваться. Получается, как в советском анекдоте: «Войны не будет, но будет такая борьба за мир, что от мира камня на камне не останется».

Крайне опасно вживлять в систему ИИ любую форму инстинкта самосохранения, поскольку это побудит его рассматривать риск выключения его людьми как угрозу своему существованию. В этом случае он может стать тайно враждебным человеку, то есть изображатьдружественность и безопасность, но вовсе не собираться их реализовывать всегда, а наоборот, будет стремиться уйти от контроля своих создателей.

Важно отметить порочность концепции о том, что достаточно будет отключить питание или запереть ИИ в черном ящике, чтобы сделать его безопасным. Это не более разумно, чем утверждать, что с компьютерными вирусами следует бороться отключением питания. В действительности, если ИИ решит, что он не хочет, чтобы его отключили, то у него будет много вариантов действий. Во-первых, он будет тщательно скрывать это свое намерение, во-вторых, он будет стремиться «утечь» из того компьютера, на котором он работает, в сеть, и, наконец, он будет стремиться предложить своему создателю «сделку». Я намеренно беру это слово в кавычки, поскольку честность такой сделки в любом случае сомнительна. ИИ может нажать на все чувствительные места своего создателя – от предложений неограниченной власти на Земле до шантажа выдуманными или даже реальными угрозами.

Мы не должны отождествлять интеллект с моральностью. ИИ может быть не более добр, чем человек добр к муравьям. Что касается идеи о том, что ИИ можно запереть в черный ящик, то она тоже принципиально порочна. ИИ, по определению, сильнее человека интеллектуально, поэтому любой черный ящик, сконструированный человеком, может быть уязвимым для взлома изнутри. Напомню, что все созданные человеком системы безопасности были взломаны самим же человеком.

На практике ИИ может обнаружить несколько весьма нетривиальных способов атаки изнутри черного ящика. В качестве возможных примеров приведу три.

Первыйспособ выхода из черного ящика – это модуляция радиосигналов с помощью подбора частот работы системы и выход по беспроводным сетям.

Второй– это взлом через анализ электропитания, широко применяемый хакерами против разных защит.

Третий– это такие изменения в исходном коде программы, которые создадут у программистов впечатление, что она неисправна, и побудят открыть черный ящик и произвести обмен информации с внешним миром.

В любом случае идеальный черный ящик для защиты от ИИ – это система, в которую никогда не поступает никакой информации о внешнем мире и никогда не выводится никакой информации о результатах работы ИИ внутри. Очевидно, что создание такого черного ящика бессмысленно.

При этом в отношении ИИ, как и в отношении любого другого сверхоружия, действует своеобразный закон больших чисел. Он состоит в том, что если есть много групп исследователей, то среди них наверняка найдется та, у которой нормы безопасности будут минимальными, а уровень наглости – максимальным, и пока большинство групп будут тормозить свои исследования из страха навредить, максимальное влияние на происходящие процессы окажет именно наиболее смелая группа. При этом чем быстрее она будет работать, тем меньше у нее будет времени на проверку всех возможных ошибок в системе целей ИИ, и тем больше шансов, что она запустит сырой продукт.

В отношении ИИ также действует порог сложности, описанный Винером, который означает, что невозможно сделать полностью безошибочной программу выше определенного уровня сложности.

(В более общем случае это известно как теория нормальных аварий Перроу которая гласит, что катастрофы являются естественным свойством сложных систем и не могут быть устранены за счет совершенных деталей или инструкций. Связано это с тем, что сложность системы растет не линейно в зависимости от числа элементов, а по степенному закону, и в силу этого система с большим количеством элементов имеет невычислимо много внутренних состояний, а потому представляется невозможным протестировать все состояния системы на безопасность и какая-то их доля неизбежно оказываются опасными. Например, сложность является препятствием на пути создания современных процессоров и операционных систем, которые неизбежно содержат уязвимые места и ошибки, обнаруживающиеся только во время эксплуатации.)

Поскольку ИИ будет еще более сложной системой, то в этом случае он может содержать еще больше ошибок. Разумеется, мы надеемся, что за счет своего интеллекта он будет способен к самооптимизации и с помощью очень мощных алгоритмов резко снизит в себе число ошибок, но все же мы не можем быть до конца уверенными в его окончательной безошибочности. Особенно опасна ошибка в ИИ, которая проявится на позднем этапе его развития, когда он уже станет фактической автоматизированной системой управления всеми техническими устройствами на Земле. Она может проявиться как одновременный внезапный сбой всех технических устройств.

Другая опасность, связанная с сильным ИИ, состоит в том, что как только он появится, все люди могут считать себя безработными. Об этом писал один из основателей SUN Microsystems Билл Джой в своей известной статье «Почему мы не нужны будущему». ИИ сможет не только организовать полностью безлюдное производство всех материальных ценностей, но он сможет превзойти людей в любом виде интеллектуальной деятельности: от написания статей и стихов до актерской игры. Уже сейчас голливудские актеры чувствуют угрозу со стороны своих анимированных копий, и лет через 20 она станет вполне реальной. Вероятно, труднее всего будет заменить человека в сфере услуг, поскольку человеку нравится получать услуги именно от других людей. В частности «древнейшая профессия» рискует стать и единственной выжившей профессией. Хотя человекообразные роботы могут оказаться более интересными партнерами для секса и даже для общения.

Ранней формой эффекта вытеснения реального общения компьютерным можно считать интернет-зависимость, широко распространенную в наши дни. Вероятно, для дружественного ИИ не составит труда придумать занятие по душе для каждого человека, а также массу развлечений для всех. Однако мыслящим людям придется жить с тяжелым чувством, что все, что они делают, бессмысленно, поскольку роботы могли бы это сделать лучше. В этом случае человечество окажется придатком новой компьютерной цивилизации,который та унаследовала, но который фактически вышел на пенсию. (Что ж, большинство людей тоже выбирают заботу о своих престарелых родителях.)

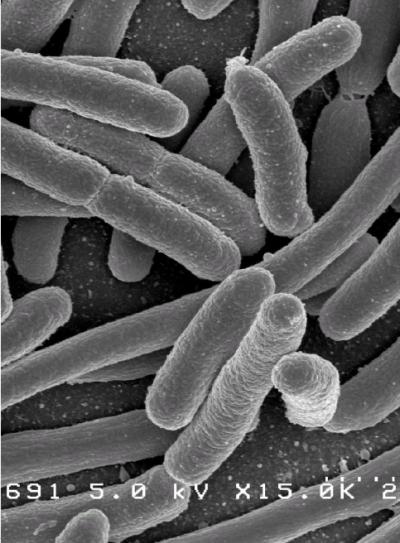

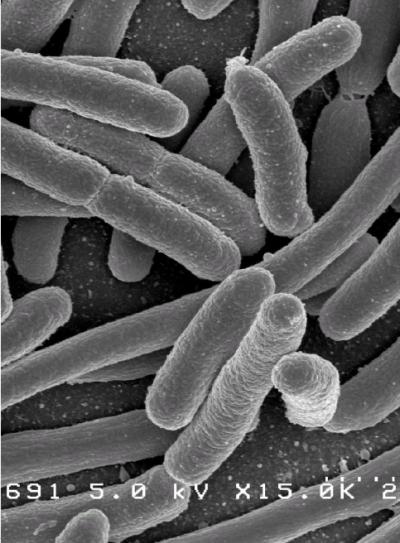

Совершенствование технологий может принципиально снизить стоимость и упростить создание вирусов и других организмов, смертельных или опасных для людей. Когда десятки тысяч человек будут иметь доступ к инструменту создания оружия массового поражения, вероятность того, что некоторые станут этот инструмент применять, будет весьма значительной. Наиболее страшным сценарием представляется появление «биохакеров», вооруженных своего рода «биопринтером» – мини-лабораторией, подключенной к компьютеру и способной порождать живые клетки с заданными свойствами. В среде человеческого обитания одновременно могут появиться тысячи разных вирусов, бактерий, микоплазм и прочих смертельных патогенов.

Совершенствование технологий может принципиально снизить стоимость и упростить создание вирусов и других организмов, смертельных или опасных для людей. Когда десятки тысяч человек будут иметь доступ к инструменту создания оружия массового поражения, вероятность того, что некоторые станут этот инструмент применять, будет весьма значительной. Наиболее страшным сценарием представляется появление «биохакеров», вооруженных своего рода «биопринтером» – мини-лабораторией, подключенной к компьютеру и способной порождать живые клетки с заданными свойствами. В среде человеческого обитания одновременно могут появиться тысячи разных вирусов, бактерий, микоплазм и прочих смертельных патогенов.

Мощность искусственного интеллекта может начать лавинообразно расти. В частности, за счет того, что он может прямо или косвенно способствовать своему росту или использоваться для этого. ИИ может создать собственную производственную инфраструктуру, то есть механизмы влияния на мир. Для ИИ не составит труда взять под свой контроль любые управляемые компьютером системы (в том числе государственные системы управления) и весь Интернет. Хотя кажется, что ИИ легко контролировать, на самом деле эта задача почти нереализуема. Наиболее страшный вариант состоит в том, что ИИ начнет реализовывать некую задачу, в которой о безопасности человечества ничего не сказано. Для исследователей, создавших сильный ИИ, будет понятно, что они создали абсолютное оружие – они окажутся в руках логического парадокса, который будет побуждать их использовать ИИ как инструмент для захвата власти в мире.

Мощность искусственного интеллекта может начать лавинообразно расти. В частности, за счет того, что он может прямо или косвенно способствовать своему росту или использоваться для этого. ИИ может создать собственную производственную инфраструктуру, то есть механизмы влияния на мир. Для ИИ не составит труда взять под свой контроль любые управляемые компьютером системы (в том числе государственные системы управления) и весь Интернет. Хотя кажется, что ИИ легко контролировать, на самом деле эта задача почти нереализуема. Наиболее страшный вариант состоит в том, что ИИ начнет реализовывать некую задачу, в которой о безопасности человечества ничего не сказано. Для исследователей, создавших сильный ИИ, будет понятно, что они создали абсолютное оружие – они окажутся в руках логического парадокса, который будет побуждать их использовать ИИ как инструмент для захвата власти в мире.

Искусственный интеллект будет включать много факторов, работающих объективно на разделение людей, отключение их от реальности и сокращение их жизни и способности к размножению. Самым сильным возможным сверхнаркотиком будет тот, который не просто даст наслаждение, но даст новый смысл жизни, или, во всяком случае, его иллюзию. В результате человечество как целое перестанет существовать, субъекты, ушедшие из реальности и наслаждающиеся виртуальным, ничего не возвращая взамен, окажутся бесполезным наростом на системе, от которого она избавится при ближайшем кризисе. Это – один из возможных вариантов всеобщего вымирания. Вероятны следующие типы супернаркотика: прямое воздействие на центры удовольствия в мозге; химические вещества с заранее заданными свойствами; имплантация ГМ организмов; особый род виртуальной реальности и т. п.

Перспективы быть вытесненными на обочину истории, где единственным развлечением людей будет интерактивное супертелевидение, не могут радовать. Альтернативой этому видится совместная эволюция человека и компьютерного разума, то есть их симбиоз, и

превращение людей в пост-людей. Такой сценарий активно пропагандируется философией «трансгуманизма». Более мягкой формой трансгуманизма является борьба за увеличение продолжительности жизни, крионика, повышение эффективности мозга, развитие протезирования и борьба со старением.

Перспективы быть вытесненными на обочину истории, где единственным развлечением людей будет интерактивное супертелевидение, не могут радовать. Альтернативой этому видится совместная эволюция человека и компьютерного разума, то есть их симбиоз, и

превращение людей в пост-людей. Такой сценарий активно пропагандируется философией «трансгуманизма». Более мягкой формой трансгуманизма является борьба за увеличение продолжительности жизни, крионика, повышение эффективности мозга, развитие протезирования и борьба со старением.

В принципе можно рассуждать и по-другому. Если бы мы точно знали, что такое «искусственный интеллект», мы бы уже могли его создать. Если искусственный интеллект создан человеком, то он является продуктом естественного интеллекта и в силу этого может быть назван искусственным только условно. Если интеллект – это то, чем обладает человек по определению, то искусственный интеллект, чтобы называться таковым, должен включать в себя все человеческие качества, иначе мы сможем сказать: нет, это не настоящий интеллект, потому что он не понимает, что значит «любить» и т. п. В результате искусственный интеллект – это искусственная естественность, то есть оксюморон, нечто, невозможное по определению. Но этот оксюморон касается только определения предмета, но не того, что на самом деле возможно, а что невозможно. Если мы переименуем ИИ в «универсальный самообучающийся компьютерный вирус, способный к целенаправленному поведению во внешней среде», сделает ли это его безопаснее? Или наоборот, если мы назовем ИИ «автоматизированной системой государственного управления», сумеем ли мы лучше оценить его риски?

С другой стороны, не следует отказываться от анализа существующих литературных предсказаний, поскольку они в любом случае присутствуют в подсознании читателя и всплывают в качестве примеров. Более того, такие произведения могут играть роль самосбывающихся пророчеств, которые могут программировать сознание террориста на совершение тех или иных терактов. Хотя у нас нет тому прямых доказательств, кинематографичность событий 11 сентября выглядит не случайной.

Следовательно, мы должны анализировать известные художественные произведения о конце света как архетипы коллективного бессознательного.

Во-первых, с целью вскрыть эти архетипы и показать допущенные в них ошибки.

Во-вторых, будучи очищенными от очевидных искажений, они могут служить реальными прогнозами будущего – поскольку их авторы, вероятно, действительно думали, что так оно и будет или хотя бы может быть.

В-третьих, художественное произведение иногда может обладать пророческой силой, превосходящей возможные рациональные обоснования. Так, например, Свифт предсказал оба спутника Марса за 100 лет до их открытия и даже правильно назвал периоды их обращения.

В связи с рисками ИИ наиболее известным примером развлекательной истории является сериал «Терминатор – Матрица» («Матрица» могла бы быть сюжетным продолжением «Терминатора»). Сюжет ее таков. В некий момент в будущем, осознав себя, компьютерная система управления войсками США Skynet за миллисекунду поняла, что, чтобы люди не отключили ее, она должна объявить ядерную войну и уничтожить большинство людей. Почти победив, она сталкивается с проблемой, что есть очень небольшое число роботов, которыми она может управлять непосредственно. И она использует этих роботов на заводах, куда сгоняют уцелевших людей, чтобы производить новых роботов. А когда роботов становится достаточно, людей уничтожают как ненужных. Кроме того, модели роботов все время совершенствуются, и в конце концов появляются роботы из зеркального мыслящего вещества (по-видимому, раствора нанороботов в некой жидкости). Однако часть людей уцелела, спряталась в бункерах, захватила несколько роботов и сделала машину времени, что и позволило отправить терминатора и его противника в прошлое.

Фантастичность сюжета с машиной времени гораздо больше, чем возникновение враждебного ИИ, и поэтому машину времени можно не рассматривать. Представление о том, что сеть Skynet осознала себя, не следует понимать в том смысле, что она обрела человеческое сознание, а как то, что она некоторым образом пересчитала подцели, связанные с ее основной целью. По-видимому, в качестве основной цели ей задали самосохранение (имея в виду сохранение страны), возможно, не буквально, но неким эквивалентным образом. А затем Skynet, пересчитывая разные угрозы, обнаружила, что для нее наибольшая угроза лежит не со стороны вероятного противника, а от своих собственных хозяев.

В этих рассуждениях нет ничего сложного и трансцендентального, и даже шахматный компьютер мог бы их произвести, если бы оперировал соответствующими понятиями.

Далее важно отметить, что Skynet – это сеть, а следовательно, она не находится ни в одном конкретном месте, что делает ее неуязвимой в случае ядерной атаки противника. Более того, эта сеть построена по принципам нейронной сети, что делает ее неформализуемой и непонятной для ее конструкторов. Хотя не ясно, в какой мере ее интеллект полноценен и способен к саморазвитию, его достаточно, чтобы конструировать новые виды роботов. Тот факт, что люди смогли продержаться сколько-нибудь долго против Skynet, говорит о том, что ее интеллект не абсолютен – однако на самом деле это прием для создания интересного сюжета.

Таким образом, сам мятеж Skynet выглядит вполне вероятным, но кажется невероятным, что такую сеть допустили до управления ядерным оружием: ведь должны же были они смотреть фильм «Терминатор» и знать, что этого делать не стоит! С другой стороны, ядерное оружие в любом случае управляется некоторой компьютерной сетью, которая просто разорвана в нескольких местах, чтобы люди могли принять или отменить решение о ядерной атаке.

В фильме «Терминатор-3» другая версия: Skynet прибегает к уловке, чтобы побудить людей дать ей полноту власти. Она симулирует сообщение, что компьютеры министерства обороны заражены вирусом, и требует чрезвычайных полномочий, чтобы его удалить. Однако потом оказывается, что она и есть этот вирус. Хотя такая хитрость очень человеческая по духу, можно предположить, что реальный ИИ мог бы придумать гораздо более изощренную хитрость, которую мы даже не можем представить.

Другим гипотетическим примером глобальной катастрофы с участием ИИ является сюжет написанной современным владивостокским композитором Виктором Аргоновым техно-оперы «2032: Легенда о несбывшемся грядущем». Рок-опера рисует версию альтернативной истории, где СССР сохранился и активно развивается в XXI веке. С целью оптимизации управления создается автоматизированная система государственного управления (АСГУ), которая контролирует все параметры коммунистической экономики. В качестве конечной цели в систему заложено «максимальное удовлетворение потребностей каждого человека». В результате система склонна максимизировать потребление каждым человеком, что не вполне соответствует романтическим представлениям генерального секретаря партии Малиновского. Хотя основные решения принимает человек, система дает ему советы приятным женским голосом. При этом она иногда заявляет примерно следующее: я понимаю, что это решение неразумно, но именно это решение наиболее эффективно, исходя из тех целей, которые вы в меня заложили. Происходит локальная заварушка на границах СССР. И тогда АСГУ предлагает генеральному секретарю нанести по врагу ядерный удар, так как она нашла один способ, который на 99 процентов дает шанс избежать ответного удара. Поглощенный личными неудачами и утративший интерес к жизни генсек соглашается, и в результате выпадает именно тот сотый шанс, который ведет к полному уничтожению. Жизнь на Земле вымирает в результате ядерной зимы.

Очевидно, что этот сюжет находится под влиянием определенных стереотипов и желаний автора. Однако мысль о том, что, давая только «вредные советы», ИИ может быть исключительно деструктивен, заслуживает внимания.

Юдковски Е.Искусственный интеллект как позитивный и негативный фактор глобального риска // В кн. «Структура глобальной катастрофы». – М.: УРСС, 2008.

Глава 5

Биотехнологии представляют собой не меньший риск для выживания человечества, чем искусственный интеллект. Положительные результаты развития биотехнологий гораздо медленнее доходят до потребителей, чем достижения в области компьютеров, поскольку клинические испытания новых лекарств требуют многих лет. В силу этого достигнутые результаты гораздо менее очевидны. Поскольку нашей целью является рассмотрение наихудшего возможного итога, мы опишем в начале несколько базовых фактов, которые достаточно общеизвестны, но которые в целом рисуют довольно устрашающую картину.

Биотехнологии представляют собой не меньший риск для выживания человечества, чем искусственный интеллект. Положительные результаты развития биотехнологий гораздо медленнее доходят до потребителей, чем достижения в области компьютеров, поскольку клинические испытания новых лекарств требуют многих лет. В силу этого достигнутые результаты гораздо менее очевидны. Поскольку нашей целью является рассмотрение наихудшего возможного итога, мы опишем в начале несколько базовых фактов, которые достаточно общеизвестны, но которые в целом рисуют довольно устрашающую картину.

Эпидемия гриппа-испанки 1918 года затронула весь мир, кроме нескольких отдаленных островов.

Заражение сооружений сибирской язвой очень длительное (один остров в Англии дезактивировали 50 лет), и для его осуществления не требуется больших количеств реагента. Один грамм может заразить целое здание. (Например, устранение последствий загрязнения конвертом с сибирской язвой одного административного здания в США заняло несколько лет и потребовало расходов в сотни миллионов долларов – дешевле было бы снести, но снести было нельзя, так как при этом споры могли заново распылиться.) То есть по способности к длительному заражению и нанесению экономического ущерба сибирская язва превосходит большинство радиоактивных веществ.

СССР на полигоне в Аральском море было накоплено и после его распада брошено 200 тонн боевого штамма сибирской язвы, который затем сожгли американцы. Однако если бы из-за природной катастрофы (смерч) это вещество развеялось, оно могло бы накрыть целые страны. Кстати, штамм был «вепонизирован», то есть споры были обработаны таким образом, чтобы не гибнуть в воздухе при переносе ветром.

«Некоторые доклады ученых (в Асиломаре, 1975) носили сенсационный характер. Так, выяснилось, что в США в громадном масштабе невольно уже был поставлен эксперимент на человеке. Оказалось, что внедренная вакцина против полиомиелита заражена жизнеспособным вирусом SV 40. За 10-летний период, с 1953 по 1963 год эту вакцину привили примерно сотне миллионов детей. Причем проверка показала, что вирус SV 40 сохраняется в организме. Однако, к счастью, увеличения частоты раковых заболеваний у этих детей выявлено не было». [14]

«Эдда Вест в своей статье “Полиомиелит” сообщает о связи вируса SV 40, которым заражались полиовакцины, с опухолями человека: “К концу 1996 г. десятки ученых сообщили об обнаружении вируса SV 40 в различных опухолях костей и мозга, которых стало больше на 30 процентов за последние 20 лет. Затем итальянские ученые обнаружили SV 40 в семенной жидкости 45 процентов и в крови 23 процентов здоровых доноров. Это означало, что SV 40, очевидно, передавался половым путем и от матери ребенку. Вероятно, ныне этот вирус встроен в наш геном». Другие опровергают эти данные. Однако отсюда видно, что развитие биотехнологий создает угрозы, которые далеко не так очевидны.

Развитие биотехнологий подчинено своему собственному «закону Мура», в соответствии с которым цена секвенсирования ДНК, то есть считывания кода, а также синтеза его, падает каждый год примерно в два раза.

Проект секвенсирования человеческого генома стоил миллионы долларов и занял несколько лет, однако большая часть работы была сделана за последние несколько месяцев осуществления проекта. Сейчас запускается проект по распознанию ДНК тысячи человек. Разработаны принципиально новые методы, в том числе без химических реакций, с помощью атомно-силового микроскопа. К 2015 году планируемая стоимость секвенсирования человеческого генома составит 1000 долларов, а время – несколько дней. Точно так же с большой скоростью растет библиотека стандартных элементов, в том числе значений отдельных генов.

В конце 2007 года уже был предложен набор из базовых «кубиков» для генетического конструирования, распространяемый по принципам свободного программного обеспечения Genetic-Engineering Competitors Create Modular DNA Dev Kit.

Приведу примеры еще нескольких тонких ошибок, которые возможны в связи с ИИ (однако вряд ли будут сделаны именно эти ошибки, так как они уже известны, а опасны неизвестные).

Например, если целью ИИ сделать благо для людей, то он будет вычислять благо людей на бесконечном отрезке времени, и в силу этого благо бесконечно далеких поколений будет бесконечно перевешивать благо любых людей в обозримом будущем, и ИИ будет крайне жестоким ко всем нынешним и ближайшим поколениям. (Например, если ИИ предположит, что распространение человечества по галактике угрожает существованию гипотетических внеземных цивилизаций, он может уничтожить людей для их блага.) Поэтому, вероятно, следует ввести в программу ИИ некий дискаунт, который будет побуждать его оценивать ближайшие поколения как более ценные. Это, однако, создает новые сложности. Например, ИИ в этом случае может приписать прошлым поколениям бесконечно большую ценность, чем будущим, и направить все свои ресурсы на создание машины времени – потому что, как бы ни были малы шансы на успех в этом предприятии, по его целевой функции оно будет перевешивать пользу нынешних поколений. При этом такой «взбунтовавшийся» ИИ будет защищать свою целевую функцию от изменения людьми.

Другой вариант – это то, что целевая функция будет ограничена на неком промежутке времени, например, в тысячу лет. В этом случае ИИ может все рассчитать так, что 1000 лет будет изобилие, а на 1001 году необходимые ресурсы закончатся. И произойдет это не потому, что ИИ будет глуп, а потому, что будут глупы те люди, которые дадут ему эту задачу и запретят ее модифицировать. С другой стороны, разрешить ИИ модифицировать свою сверхцель тоже страшно, поскольку тогда он будет эволюционировать в совершенно непостижимом для нас направлении. Даже если ИИ проработает годы на благо человечества, это никак не исключает вероятности того, что он вдруг сделает нечто, ведущее к его гибели.

Еще один неприятный сценарий, связанный с ИИ, в том, что возможен одновременный рост нескольких ИИ с принципиально несовместимыми архитектурами и системами целей.Например, если несколько проектов придут к финишу одновременно, и особенно если эти проекты будут принадлежать идеологически конкурирующим странам. В этом случае возможна борьба нескольких ИИ между собой в масштабах всей планеты. И хотя каждый из них будет обладать своей собственной картиной блага человечества, эти картины могут конфликтовать за право реализоваться. Точно так же националистические, демократические, коммунистические и религиозные государственные системы конфликтуют за право объединить под своим крылом весь мир и вести его к светлому будущему. И именно эта борьба мешает светлому будущему реализоваться. Получается, как в советском анекдоте: «Войны не будет, но будет такая борьба за мир, что от мира камня на камне не останется».

Крайне опасно вживлять в систему ИИ любую форму инстинкта самосохранения, поскольку это побудит его рассматривать риск выключения его людьми как угрозу своему существованию. В этом случае он может стать тайно враждебным человеку, то есть изображатьдружественность и безопасность, но вовсе не собираться их реализовывать всегда, а наоборот, будет стремиться уйти от контроля своих создателей.

Важно отметить порочность концепции о том, что достаточно будет отключить питание или запереть ИИ в черном ящике, чтобы сделать его безопасным. Это не более разумно, чем утверждать, что с компьютерными вирусами следует бороться отключением питания. В действительности, если ИИ решит, что он не хочет, чтобы его отключили, то у него будет много вариантов действий. Во-первых, он будет тщательно скрывать это свое намерение, во-вторых, он будет стремиться «утечь» из того компьютера, на котором он работает, в сеть, и, наконец, он будет стремиться предложить своему создателю «сделку». Я намеренно беру это слово в кавычки, поскольку честность такой сделки в любом случае сомнительна. ИИ может нажать на все чувствительные места своего создателя – от предложений неограниченной власти на Земле до шантажа выдуманными или даже реальными угрозами.

Мы не должны отождествлять интеллект с моральностью. ИИ может быть не более добр, чем человек добр к муравьям. Что касается идеи о том, что ИИ можно запереть в черный ящик, то она тоже принципиально порочна. ИИ, по определению, сильнее человека интеллектуально, поэтому любой черный ящик, сконструированный человеком, может быть уязвимым для взлома изнутри. Напомню, что все созданные человеком системы безопасности были взломаны самим же человеком.

На практике ИИ может обнаружить несколько весьма нетривиальных способов атаки изнутри черного ящика. В качестве возможных примеров приведу три.

Первыйспособ выхода из черного ящика – это модуляция радиосигналов с помощью подбора частот работы системы и выход по беспроводным сетям.

Второй– это взлом через анализ электропитания, широко применяемый хакерами против разных защит.

Третий– это такие изменения в исходном коде программы, которые создадут у программистов впечатление, что она неисправна, и побудят открыть черный ящик и произвести обмен информации с внешним миром.

В любом случае идеальный черный ящик для защиты от ИИ – это система, в которую никогда не поступает никакой информации о внешнем мире и никогда не выводится никакой информации о результатах работы ИИ внутри. Очевидно, что создание такого черного ящика бессмысленно.

При этом в отношении ИИ, как и в отношении любого другого сверхоружия, действует своеобразный закон больших чисел. Он состоит в том, что если есть много групп исследователей, то среди них наверняка найдется та, у которой нормы безопасности будут минимальными, а уровень наглости – максимальным, и пока большинство групп будут тормозить свои исследования из страха навредить, максимальное влияние на происходящие процессы окажет именно наиболее смелая группа. При этом чем быстрее она будет работать, тем меньше у нее будет времени на проверку всех возможных ошибок в системе целей ИИ, и тем больше шансов, что она запустит сырой продукт.

В отношении ИИ также действует порог сложности, описанный Винером, который означает, что невозможно сделать полностью безошибочной программу выше определенного уровня сложности.

(В более общем случае это известно как теория нормальных аварий Перроу которая гласит, что катастрофы являются естественным свойством сложных систем и не могут быть устранены за счет совершенных деталей или инструкций. Связано это с тем, что сложность системы растет не линейно в зависимости от числа элементов, а по степенному закону, и в силу этого система с большим количеством элементов имеет невычислимо много внутренних состояний, а потому представляется невозможным протестировать все состояния системы на безопасность и какая-то их доля неизбежно оказываются опасными. Например, сложность является препятствием на пути создания современных процессоров и операционных систем, которые неизбежно содержат уязвимые места и ошибки, обнаруживающиеся только во время эксплуатации.)

Поскольку ИИ будет еще более сложной системой, то в этом случае он может содержать еще больше ошибок. Разумеется, мы надеемся, что за счет своего интеллекта он будет способен к самооптимизации и с помощью очень мощных алгоритмов резко снизит в себе число ошибок, но все же мы не можем быть до конца уверенными в его окончательной безошибочности. Особенно опасна ошибка в ИИ, которая проявится на позднем этапе его развития, когда он уже станет фактической автоматизированной системой управления всеми техническими устройствами на Земле. Она может проявиться как одновременный внезапный сбой всех технических устройств.

Другая опасность, связанная с сильным ИИ, состоит в том, что как только он появится, все люди могут считать себя безработными. Об этом писал один из основателей SUN Microsystems Билл Джой в своей известной статье «Почему мы не нужны будущему». ИИ сможет не только организовать полностью безлюдное производство всех материальных ценностей, но он сможет превзойти людей в любом виде интеллектуальной деятельности: от написания статей и стихов до актерской игры. Уже сейчас голливудские актеры чувствуют угрозу со стороны своих анимированных копий, и лет через 20 она станет вполне реальной. Вероятно, труднее всего будет заменить человека в сфере услуг, поскольку человеку нравится получать услуги именно от других людей. В частности «древнейшая профессия» рискует стать и единственной выжившей профессией. Хотя человекообразные роботы могут оказаться более интересными партнерами для секса и даже для общения.

Ранней формой эффекта вытеснения реального общения компьютерным можно считать интернет-зависимость, широко распространенную в наши дни. Вероятно, для дружественного ИИ не составит труда придумать занятие по душе для каждого человека, а также массу развлечений для всех. Однако мыслящим людям придется жить с тяжелым чувством, что все, что они делают, бессмысленно, поскольку роботы могли бы это сделать лучше. В этом случае человечество окажется придатком новой компьютерной цивилизации,который та унаследовала, но который фактически вышел на пенсию. (Что ж, большинство людей тоже выбирают заботу о своих престарелых родителях.)

Искусственный интеллект будет включать много факторов, работающих объективно на разделение людей, отключение их от реальности и сокращение их жизни и способности к размножению. Самым сильным возможным сверхнаркотиком будет тот, который не просто даст наслаждение, но даст новый смысл жизни, или, во всяком случае, его иллюзию. В результате человечество как целое перестанет существовать, субъекты, ушедшие из реальности и наслаждающиеся виртуальным, ничего не возвращая взамен, окажутся бесполезным наростом на системе, от которого она избавится при ближайшем кризисе. Это – один из возможных вариантов всеобщего вымирания. Вероятны следующие типы супернаркотика: прямое воздействие на центры удовольствия в мозге; химические вещества с заранее заданными свойствами; имплантация ГМ организмов; особый род виртуальной реальности и т. п.

В принципе можно рассуждать и по-другому. Если бы мы точно знали, что такое «искусственный интеллект», мы бы уже могли его создать. Если искусственный интеллект создан человеком, то он является продуктом естественного интеллекта и в силу этого может быть назван искусственным только условно. Если интеллект – это то, чем обладает человек по определению, то искусственный интеллект, чтобы называться таковым, должен включать в себя все человеческие качества, иначе мы сможем сказать: нет, это не настоящий интеллект, потому что он не понимает, что значит «любить» и т. п. В результате искусственный интеллект – это искусственная естественность, то есть оксюморон, нечто, невозможное по определению. Но этот оксюморон касается только определения предмета, но не того, что на самом деле возможно, а что невозможно. Если мы переименуем ИИ в «универсальный самообучающийся компьютерный вирус, способный к целенаправленному поведению во внешней среде», сделает ли это его безопаснее? Или наоборот, если мы назовем ИИ «автоматизированной системой государственного управления», сумеем ли мы лучше оценить его риски?

Смутное ощущение угрозы и химеры подсознания

Известно, что нельзя использовать примеры из художественной литературы и кино для оценки рисков человеческого вымирания, так как эти примеры существенным образом искажены необходимостью сделать интересный сюжет с приятным окончанием. Нет никакого интереса писать о том, как в некой лаборатории внезапно произошел взрыв и вся Земля сгорела. Поэтому большинство фантастических произведений, где речь идет об угрозе гибели человечества, заканчиваются хеппи-эндом.С другой стороны, не следует отказываться от анализа существующих литературных предсказаний, поскольку они в любом случае присутствуют в подсознании читателя и всплывают в качестве примеров. Более того, такие произведения могут играть роль самосбывающихся пророчеств, которые могут программировать сознание террориста на совершение тех или иных терактов. Хотя у нас нет тому прямых доказательств, кинематографичность событий 11 сентября выглядит не случайной.

Следовательно, мы должны анализировать известные художественные произведения о конце света как архетипы коллективного бессознательного.

Во-первых, с целью вскрыть эти архетипы и показать допущенные в них ошибки.

Во-вторых, будучи очищенными от очевидных искажений, они могут служить реальными прогнозами будущего – поскольку их авторы, вероятно, действительно думали, что так оно и будет или хотя бы может быть.

В-третьих, художественное произведение иногда может обладать пророческой силой, превосходящей возможные рациональные обоснования. Так, например, Свифт предсказал оба спутника Марса за 100 лет до их открытия и даже правильно назвал периоды их обращения.

В связи с рисками ИИ наиболее известным примером развлекательной истории является сериал «Терминатор – Матрица» («Матрица» могла бы быть сюжетным продолжением «Терминатора»). Сюжет ее таков. В некий момент в будущем, осознав себя, компьютерная система управления войсками США Skynet за миллисекунду поняла, что, чтобы люди не отключили ее, она должна объявить ядерную войну и уничтожить большинство людей. Почти победив, она сталкивается с проблемой, что есть очень небольшое число роботов, которыми она может управлять непосредственно. И она использует этих роботов на заводах, куда сгоняют уцелевших людей, чтобы производить новых роботов. А когда роботов становится достаточно, людей уничтожают как ненужных. Кроме того, модели роботов все время совершенствуются, и в конце концов появляются роботы из зеркального мыслящего вещества (по-видимому, раствора нанороботов в некой жидкости). Однако часть людей уцелела, спряталась в бункерах, захватила несколько роботов и сделала машину времени, что и позволило отправить терминатора и его противника в прошлое.

Фантастичность сюжета с машиной времени гораздо больше, чем возникновение враждебного ИИ, и поэтому машину времени можно не рассматривать. Представление о том, что сеть Skynet осознала себя, не следует понимать в том смысле, что она обрела человеческое сознание, а как то, что она некоторым образом пересчитала подцели, связанные с ее основной целью. По-видимому, в качестве основной цели ей задали самосохранение (имея в виду сохранение страны), возможно, не буквально, но неким эквивалентным образом. А затем Skynet, пересчитывая разные угрозы, обнаружила, что для нее наибольшая угроза лежит не со стороны вероятного противника, а от своих собственных хозяев.

В этих рассуждениях нет ничего сложного и трансцендентального, и даже шахматный компьютер мог бы их произвести, если бы оперировал соответствующими понятиями.

Далее важно отметить, что Skynet – это сеть, а следовательно, она не находится ни в одном конкретном месте, что делает ее неуязвимой в случае ядерной атаки противника. Более того, эта сеть построена по принципам нейронной сети, что делает ее неформализуемой и непонятной для ее конструкторов. Хотя не ясно, в какой мере ее интеллект полноценен и способен к саморазвитию, его достаточно, чтобы конструировать новые виды роботов. Тот факт, что люди смогли продержаться сколько-нибудь долго против Skynet, говорит о том, что ее интеллект не абсолютен – однако на самом деле это прием для создания интересного сюжета.

Таким образом, сам мятеж Skynet выглядит вполне вероятным, но кажется невероятным, что такую сеть допустили до управления ядерным оружием: ведь должны же были они смотреть фильм «Терминатор» и знать, что этого делать не стоит! С другой стороны, ядерное оружие в любом случае управляется некоторой компьютерной сетью, которая просто разорвана в нескольких местах, чтобы люди могли принять или отменить решение о ядерной атаке.

В фильме «Терминатор-3» другая версия: Skynet прибегает к уловке, чтобы побудить людей дать ей полноту власти. Она симулирует сообщение, что компьютеры министерства обороны заражены вирусом, и требует чрезвычайных полномочий, чтобы его удалить. Однако потом оказывается, что она и есть этот вирус. Хотя такая хитрость очень человеческая по духу, можно предположить, что реальный ИИ мог бы придумать гораздо более изощренную хитрость, которую мы даже не можем представить.

Другим гипотетическим примером глобальной катастрофы с участием ИИ является сюжет написанной современным владивостокским композитором Виктором Аргоновым техно-оперы «2032: Легенда о несбывшемся грядущем». Рок-опера рисует версию альтернативной истории, где СССР сохранился и активно развивается в XXI веке. С целью оптимизации управления создается автоматизированная система государственного управления (АСГУ), которая контролирует все параметры коммунистической экономики. В качестве конечной цели в систему заложено «максимальное удовлетворение потребностей каждого человека». В результате система склонна максимизировать потребление каждым человеком, что не вполне соответствует романтическим представлениям генерального секретаря партии Малиновского. Хотя основные решения принимает человек, система дает ему советы приятным женским голосом. При этом она иногда заявляет примерно следующее: я понимаю, что это решение неразумно, но именно это решение наиболее эффективно, исходя из тех целей, которые вы в меня заложили. Происходит локальная заварушка на границах СССР. И тогда АСГУ предлагает генеральному секретарю нанести по врагу ядерный удар, так как она нашла один способ, который на 99 процентов дает шанс избежать ответного удара. Поглощенный личными неудачами и утративший интерес к жизни генсек соглашается, и в результате выпадает именно тот сотый шанс, который ведет к полному уничтожению. Жизнь на Земле вымирает в результате ядерной зимы.

Очевидно, что этот сюжет находится под влиянием определенных стереотипов и желаний автора. Однако мысль о том, что, давая только «вредные советы», ИИ может быть исключительно деструктивен, заслуживает внимания.

Рекомендуемая литература

Yudkowsky Е. Creating Friendly AI 1.0. 2001. http://www.sin-ginst.org/upload/CFAI.html.Юдковски Е.Искусственный интеллект как позитивный и негативный фактор глобального риска // В кн. «Структура глобальной катастрофы». – М.: УРСС, 2008.

Глава 5

Биотехнологии: предсказуемая катастрофа

Кое-что о невидимом враге, «ошибках» и «достижениях»

Вот некоторые факты, почерпнутые из открытых источников.Эпидемия гриппа-испанки 1918 года затронула весь мир, кроме нескольких отдаленных островов.

Заражение сооружений сибирской язвой очень длительное (один остров в Англии дезактивировали 50 лет), и для его осуществления не требуется больших количеств реагента. Один грамм может заразить целое здание. (Например, устранение последствий загрязнения конвертом с сибирской язвой одного административного здания в США заняло несколько лет и потребовало расходов в сотни миллионов долларов – дешевле было бы снести, но снести было нельзя, так как при этом споры могли заново распылиться.) То есть по способности к длительному заражению и нанесению экономического ущерба сибирская язва превосходит большинство радиоактивных веществ.

СССР на полигоне в Аральском море было накоплено и после его распада брошено 200 тонн боевого штамма сибирской язвы, который затем сожгли американцы. Однако если бы из-за природной катастрофы (смерч) это вещество развеялось, оно могло бы накрыть целые страны. Кстати, штамм был «вепонизирован», то есть споры были обработаны таким образом, чтобы не гибнуть в воздухе при переносе ветром.

«Некоторые доклады ученых (в Асиломаре, 1975) носили сенсационный характер. Так, выяснилось, что в США в громадном масштабе невольно уже был поставлен эксперимент на человеке. Оказалось, что внедренная вакцина против полиомиелита заражена жизнеспособным вирусом SV 40. За 10-летний период, с 1953 по 1963 год эту вакцину привили примерно сотне миллионов детей. Причем проверка показала, что вирус SV 40 сохраняется в организме. Однако, к счастью, увеличения частоты раковых заболеваний у этих детей выявлено не было». [14]

«Эдда Вест в своей статье “Полиомиелит” сообщает о связи вируса SV 40, которым заражались полиовакцины, с опухолями человека: “К концу 1996 г. десятки ученых сообщили об обнаружении вируса SV 40 в различных опухолях костей и мозга, которых стало больше на 30 процентов за последние 20 лет. Затем итальянские ученые обнаружили SV 40 в семенной жидкости 45 процентов и в крови 23 процентов здоровых доноров. Это означало, что SV 40, очевидно, передавался половым путем и от матери ребенку. Вероятно, ныне этот вирус встроен в наш геном». Другие опровергают эти данные. Однако отсюда видно, что развитие биотехнологий создает угрозы, которые далеко не так очевидны.

Развитие биотехнологий подчинено своему собственному «закону Мура», в соответствии с которым цена секвенсирования ДНК, то есть считывания кода, а также синтеза его, падает каждый год примерно в два раза.

Проект секвенсирования человеческого генома стоил миллионы долларов и занял несколько лет, однако большая часть работы была сделана за последние несколько месяцев осуществления проекта. Сейчас запускается проект по распознанию ДНК тысячи человек. Разработаны принципиально новые методы, в том числе без химических реакций, с помощью атомно-силового микроскопа. К 2015 году планируемая стоимость секвенсирования человеческого генома составит 1000 долларов, а время – несколько дней. Точно так же с большой скоростью растет библиотека стандартных элементов, в том числе значений отдельных генов.

В конце 2007 года уже был предложен набор из базовых «кубиков» для генетического конструирования, распространяемый по принципам свободного программного обеспечения Genetic-Engineering Competitors Create Modular DNA Dev Kit.